BTC/HKD+0.59%

BTC/HKD+0.59% ETH/HKD+0.45%

ETH/HKD+0.45% LTC/HKD-0.32%

LTC/HKD-0.32% ADA/HKD+0.32%

ADA/HKD+0.32% SOL/HKD+0%

SOL/HKD+0% XRP/HKD-0.01%

XRP/HKD-0.01%來源:新智元

開源先鋒StabilityAI一天扔了兩枚重磅炸彈:發布史上首個開源RLHF大語言模型,以及像素級圖像模型DeepFloydIF。開源社區狂喜!

最近,大名鼎鼎的StableDiffusion背后的公司,一連整了兩個大活。

首先,StabilityAI重磅發布了世上首個基于RLHF的開源LLM聊天機器人——StableVicuna。

StableVicuna基于Vicuna-13B模型實現,是第一個使用人類反饋訓練的大規模開源聊天機器人。

有網友經過實測后表示,StableVicuna就是目前當之無愧的13BLLM之王!

對此,1xexited創始人表示,這可以看作是自ChatGPT推出以來的第二個里程碑。

另外,StabilityAI發布了開源模型DeepFloydIF,這個文本到圖像的級聯像素擴散模型功能超強,可以巧妙地把文本集成到圖像中。

這個模型的革命性意義在于,它一連解決了文生圖領域的兩大難題:正確生成文字,正確理解空間關系!

秉持著開源的一貫傳統,DeepFloydIF在以后會完全開源。

StailibityAI,果然是開源界當之無愧的扛把子。

StableVicuna

世上首個開源RLHFLLM聊天機器人StableVicuna,由StabilityAI震撼發布!

派盾:Starship項目發生Rug Pull,損失約715枚BNB:5月25日消息,據派盾監測,基于BNB Chian的Starship項目發生Rug Pull,其代幣價格幾乎歸零,約715枚BNB轉入Tornado Cash。[2022/5/25 3:40:01]

一位Youtube主播對StableVicuna進行了實測,StableVicuna在每一次測試中,都擊敗了前任王者Vicuna。

所以這位Youtuber激動地喊出:StableVicuna就是目前最強大的13BLLM模型,是當之無愧的LLM模型之王!

StableVicuna基于小羊駝Vicuna-13B模型實現,是Vicuna-13B的進一步指令微調和RLHF訓練的版本。

而Vicuna-13B是LLaMA-13B的一個指令微調模型。

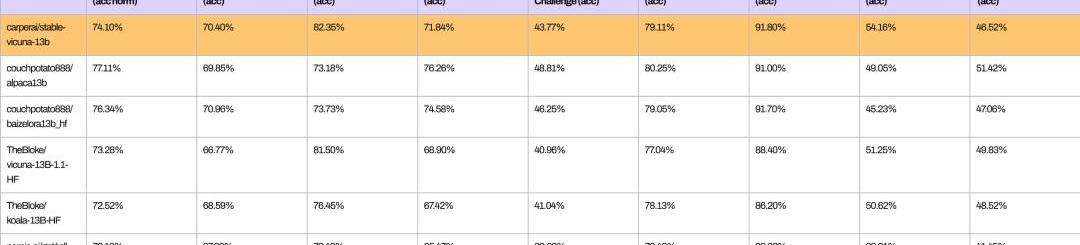

從以下基準測試可以看出,StableVicuna與類似規模的開源聊天機器人在整體性能上的比較。

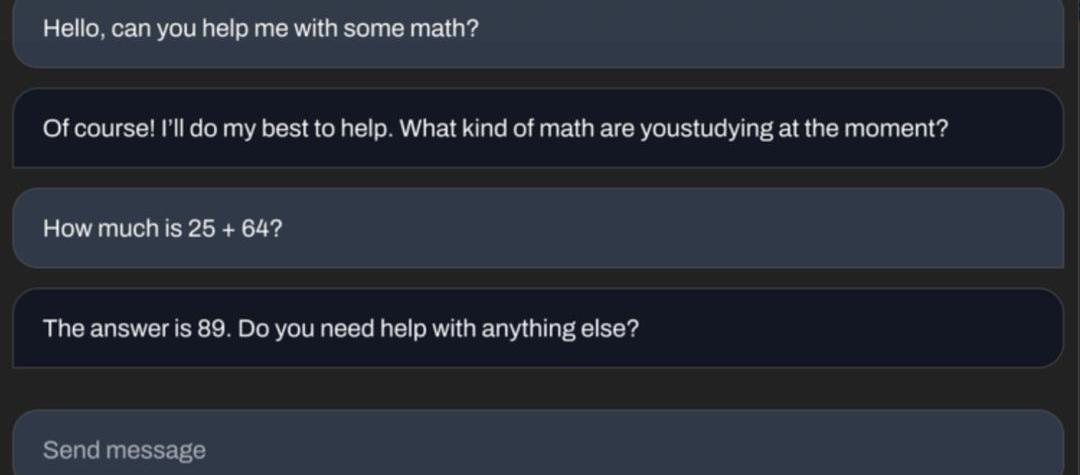

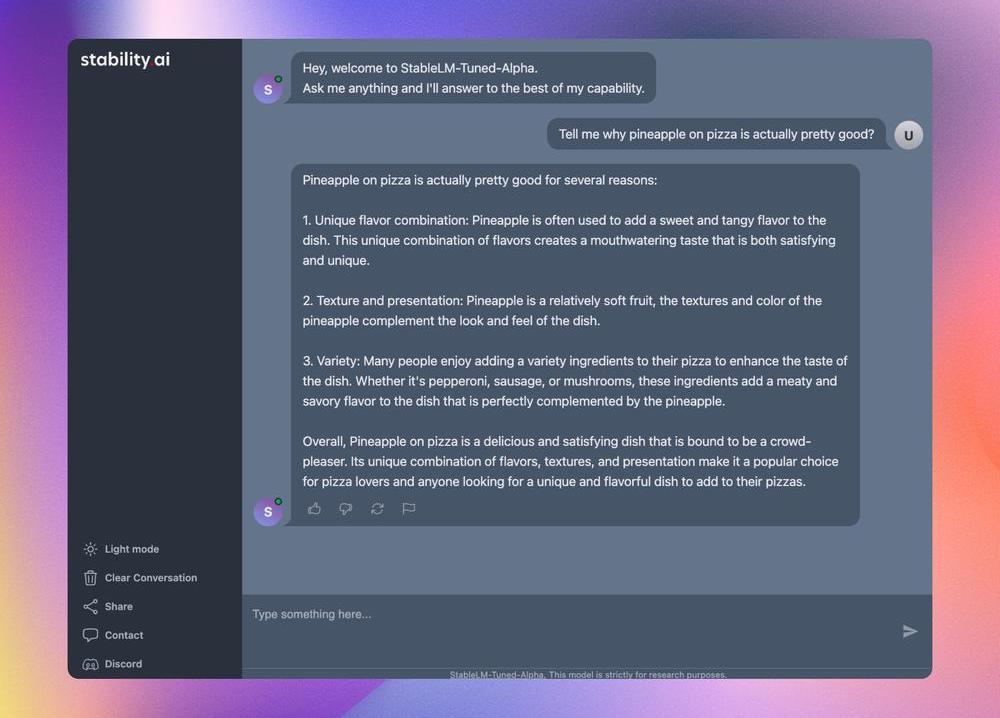

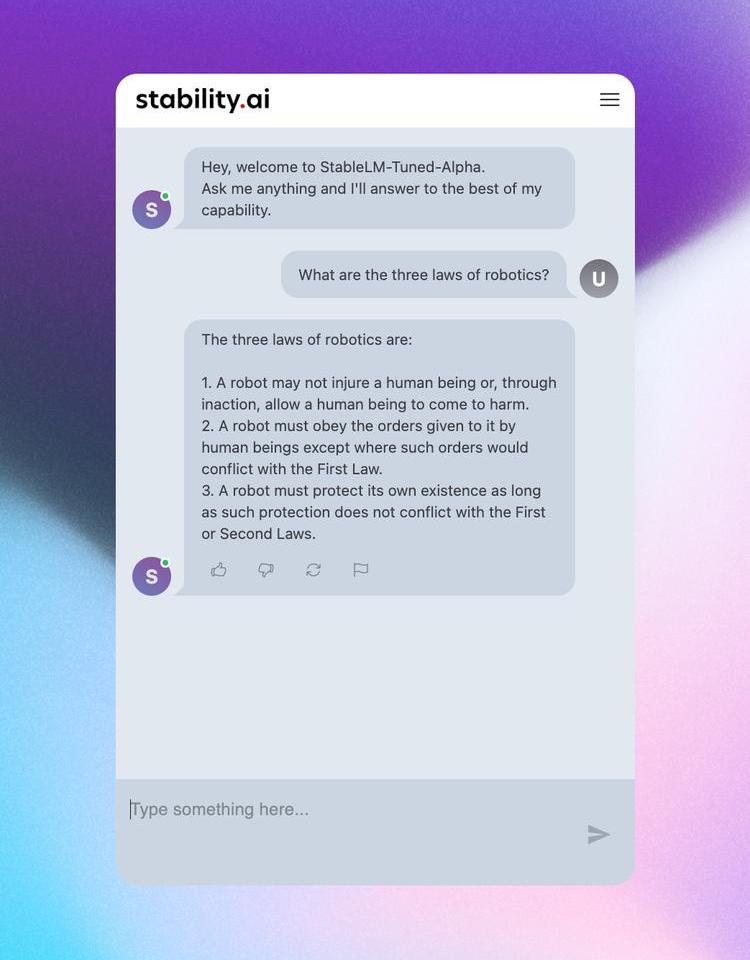

StableVicuna可以做基礎數學題。

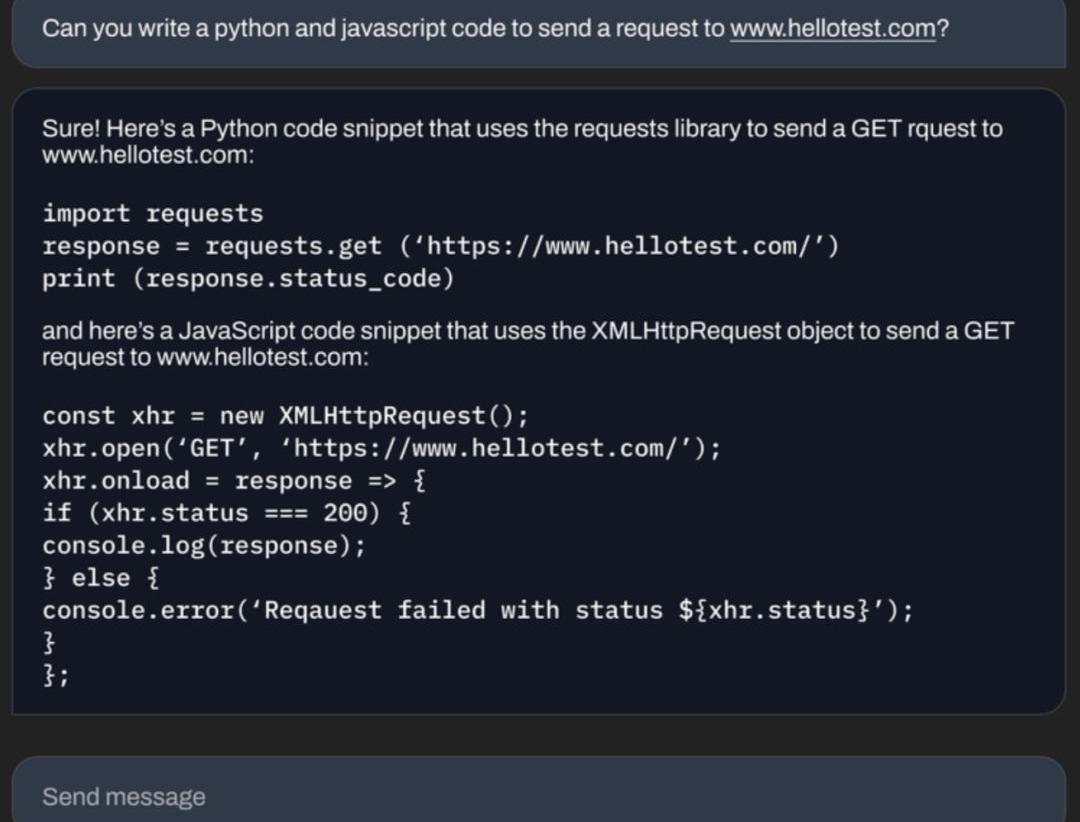

可以寫代碼。

P2E游戲公會BlockchainSpace完成240萬美元戰略融資,Morningstar Ventures領投:11月30日,P2E游戲公會BlockchainSpace宣布完成240萬美元戰略融資,Morningstar Ventures 領投,Crypto.com、Alameda Research、Kingsway Capital、OKEx Ventures、Unity Gaming 等參投。該輪融資資金將用于在其平臺上擴張 20,000 個全球游戲公會和超 1000 萬名用戶。[2021/11/30 12:41:51]

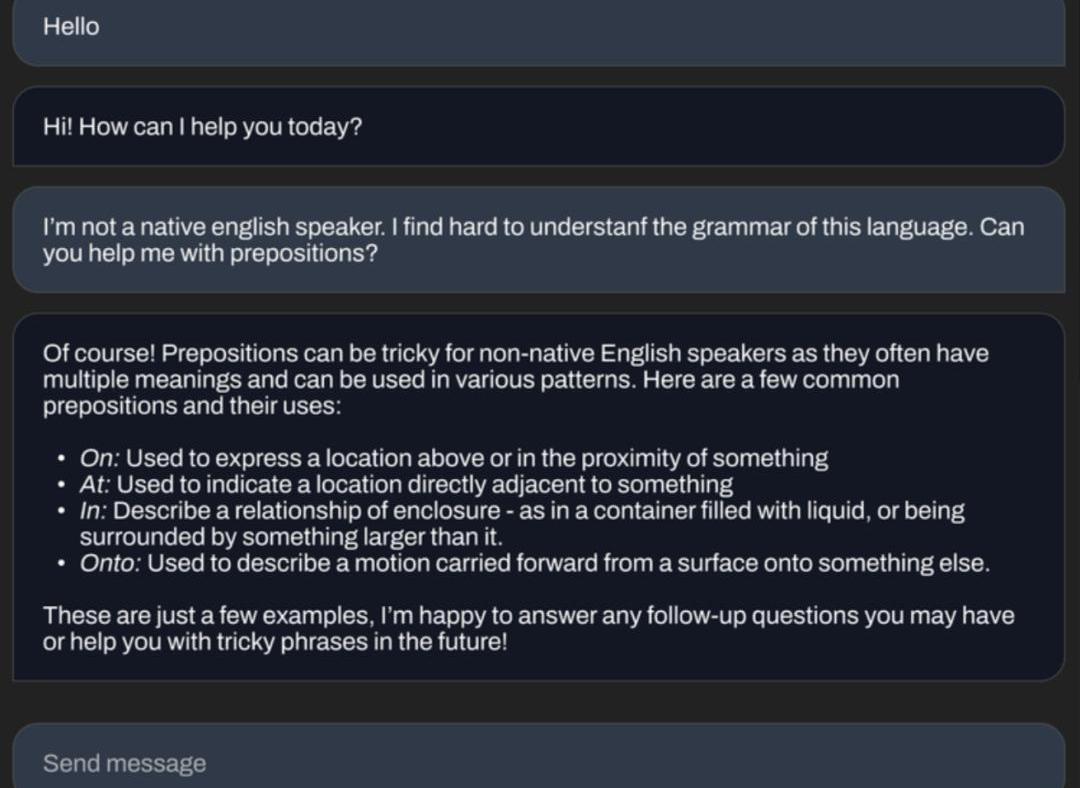

還能為你講解語法知識。

開源聊天機器人平替狂潮

StabilityAI想做這樣一個開源的聊天機器人,當然也是受了此前LLaMa權重泄露引爆的ChatGPT平替狂潮的影響。

從去年春天Character.ai的聊天機器人,到后來的ChatGPT和Bard,都引發了大家對開源平替的強烈興趣。

這些聊天模型的成功,基本都歸功于這兩種訓練范式:指令微調和人類反饋強化學習(RLHF)。

這期間,開發者一直在努力構建開源框架幫助訓練這些模型,比如trlX、trl、DeepSpeedChat和ColossalAI等,然而,卻并沒有一個開源模型,能夠同時應用指令微調和RLHF。

大多數模型都是在沒有RLHF的情況下進行指令微調的,因為這個過程十分復雜。

最近,OpenAssistant、Anthropic和Stanford都開始向公眾提供RLHF數據集。

StabilityAI把這些數據集與trlX提供的RLHF相結合,就得到了史上第一個大規模指令微調和RLHF模型——StableVicuna。

訓練過程

為了實現StableVicuna的強大性能,研究者利用Vicuna作為基礎模型,并遵循了一種典型的三級RLHF管線。

Gate.io Startup 首發項目BOSON回報率近11倍:據Gate.io芝麻開門行情顯示,Gate.io 首發項目Boson Token (BOSON)于今日下午17:00正式開盤交易,上線2小時內最高漲幅達1083.55%,最高價格11.8美元,為Startup認購價格1美元的近11倍,當前價格為4.41美元,當前漲幅為342.32%,24H現貨交易量達469.71萬美元。近期行情波動較大,請注意控制風險。[2021/4/9 20:02:53]

Vicuna在130億參數LLaMA模型的基礎上,使用Alpaca進行調整后得到的。

他們混合了三個數據集,訓練出具有監督微調(SFT)的Vicuna基礎模型:

OpenAssistantConversationsDataset(OASST1),一個人工生成的、人工注釋的助理式對話語料庫,包含161,443條消息,分布在66,497個對話樹中,使用35種不同的語言;

GPT4AllPromptGenerations,由GPT-3.5Turbo生成的437,605個提示和響應的數據集;

Alpaca,這是由OpenAI的text-davinci-003引擎生成,包含52,000條指令和演示的數據集。

研究者使用trlx,訓練了一個獎勵模型。在以下這些RLHF偏好數據集上,研究者得到了SFT模型,這是獎勵模型的基礎。

OpenAssistantConversationsDataset(OASST1),包含7213個偏好樣本;

AnthropicHH-RLHF,一個關于AI助手有用性和無害性的偏好數據集,包含160,800個人類標簽;

斯坦福人類偏好(SHP),這是一個數據集,包含348,718個人類對各種不同回答的集體偏好,包括18個從烹飪到哲學的不同學科領域。

最后,研究者使用了trlX,進行近端策略優化(ProximalPolicyOptimization,PPO)強化學習,對SFT模型進行了RLHF訓練,然后,StableVicuna就誕生了!

Marlin Protocol與StaFi Protocol達成合作,將合作開發rPOND代幣:官方消息,Layer 0擴展項目Marlin Protocol與可釋放抵押資產的流動性StaFi Protocol達成合作,雙方將攜手解決DeFi的可擴展性難題,并為Marlin的原生代幣POND開發wrapped的rPOND代幣。[2021/1/26 13:36:06]

據StabilityAI稱,會進一步開發StableVicuna,并且會很快在Discord上推出。

另外,StabilityAI還計劃給StableVicuna一個聊天界面,目前正在開發中。

相關演示已經可以在HuggingFace上查看了,開發者也可以在HuggingFace上下載模型的權重,作為原始LLaMA模型的增量。

但如果想使用StableVicuna,還需要獲得原始LLaMA模型的訪問權限。

獲得權重增量和LLaMA權重后,使用GitHub存儲庫中提供的腳本將它們組合起來,就能得到StableVicuna-13B了。不過,也是不允許商用的。

DeepFloydIF

在同一時間,StabilityAI還放出了一個大動作。

你敢信,AI一直無法正確生成文字這個老大難問題,竟然被解決了?

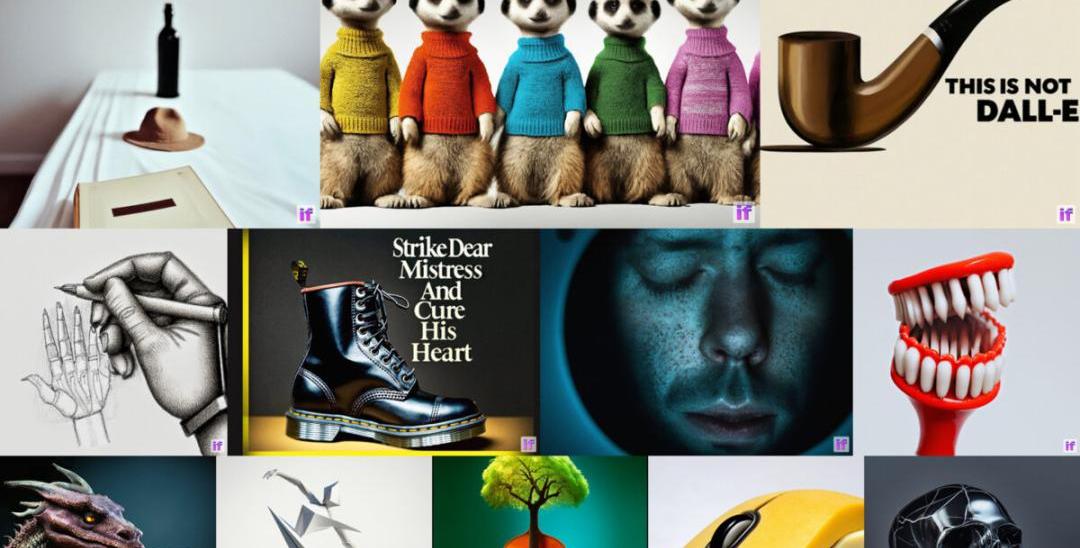

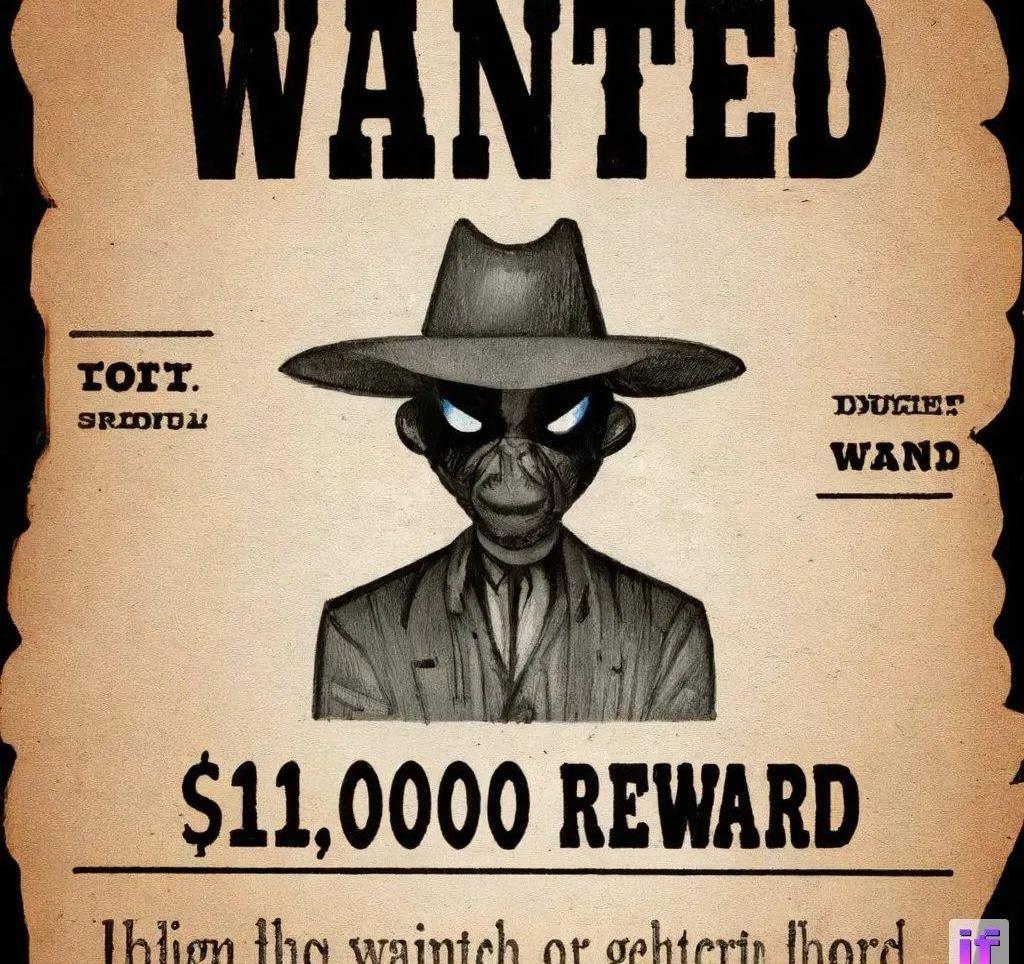

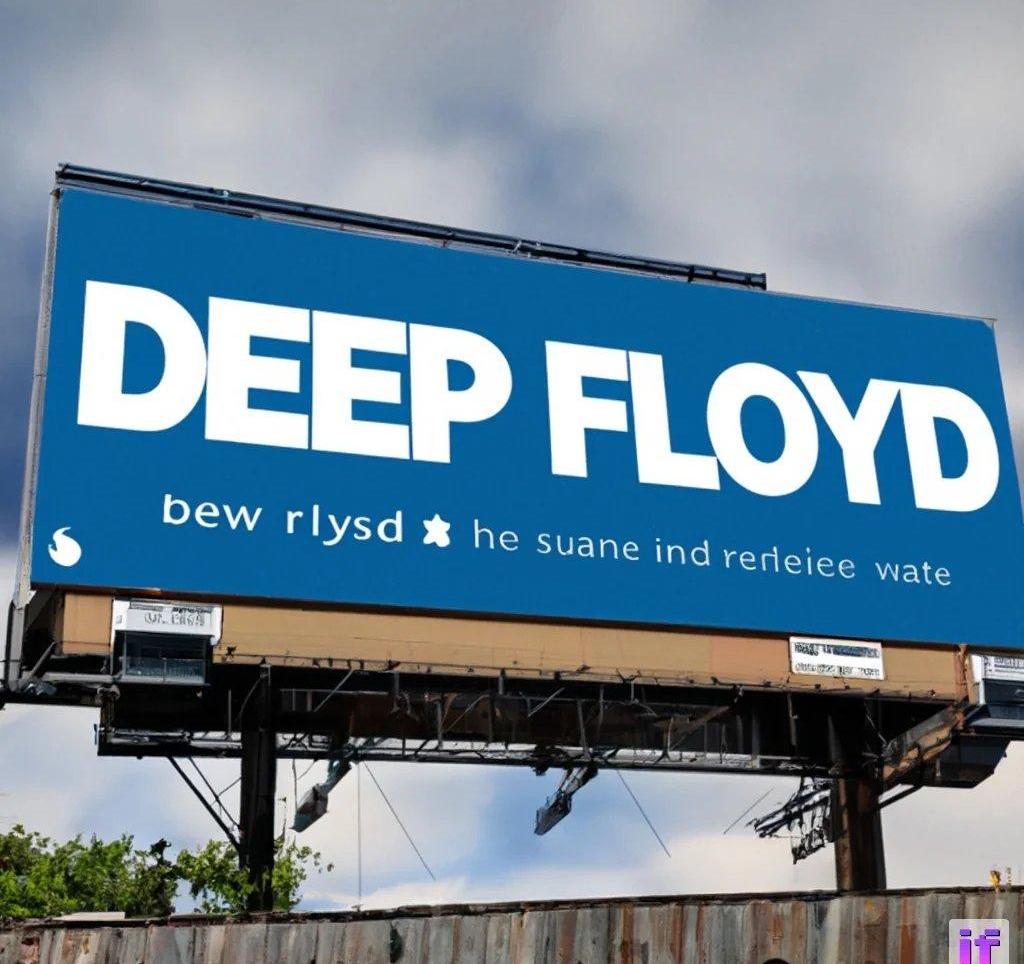

沒錯,下面這張「完美」的招牌,就是由StabilityAI全新推出的開源圖像生成模型——DeepFloydIF制作的。

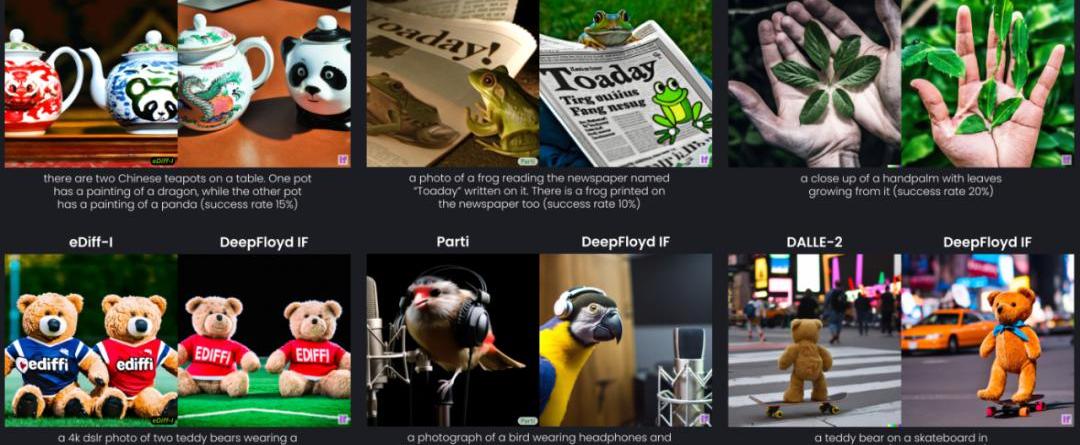

除此之外,DeepFloydIF還能夠生成正確的空間關系。

動態 | 日本“藝術+區塊鏈”風投企業Startbahn獲SBI investment A輪追加融資:據Crypto Watch消息,致力于“藝術+區塊鏈”領域的風投企業Startbahn有限公司于5月23日宣布,已完成A輪追加融資。投資方是SBI集團風投企業SBI investment股份公司運營的“SBI AI&Blockchain投資事業有限責任組合”。Startbahn一直和SBI藝術拍賣有些公司進行著業務合作,將通過此次融資繼續加強合作。[2019/5/23]

模型剛一發布,網友們已經玩瘋了:

prompt:Robotholdinganeonsignthatsays"Icanspell".

不過,對于prompt中沒有明確說明的文字,DeepFloydIF大概率還是會出錯。

prompt:AneonsignofanAmericanmotelatnightwiththesignjavilop

官方演示

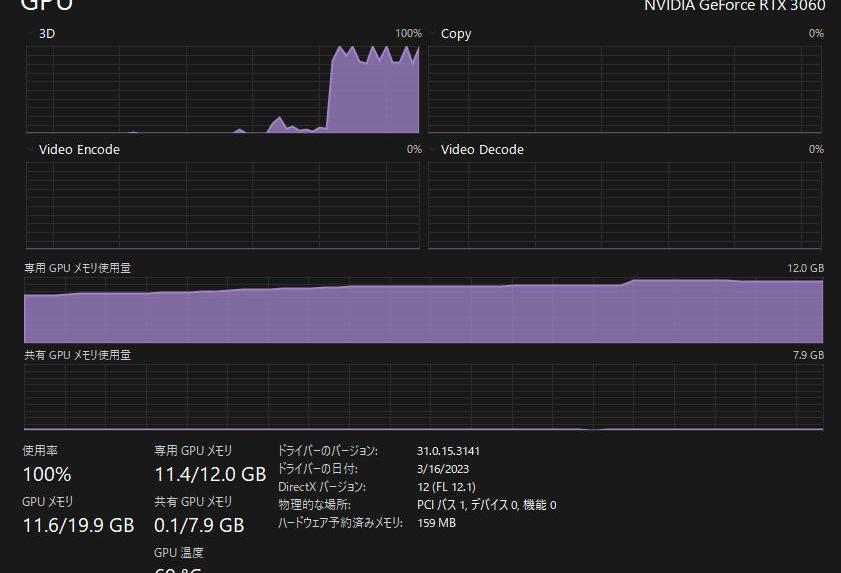

順便一提,在硬件的需求上,如果想要實現模型所能支持的最大1,024x1,024像素輸出,建議使用24GB的顯存;如果只要256x256像素,16GB的顯存即可。

是的,RTX306016G就能跑。

代碼實現:https://gist.github.com/Stella2211/ab17625d63aa03e38d82ddc8c1aae151

開源版谷歌Imagen

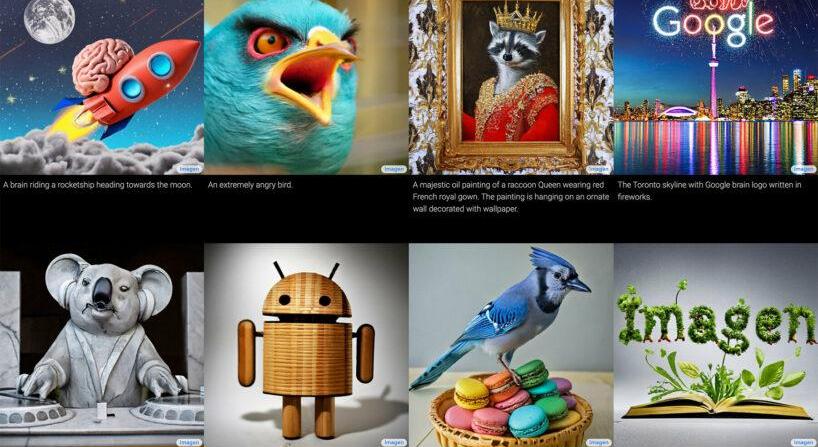

2022年5月,谷歌高調發布了自家的圖像生成模型Imagen。

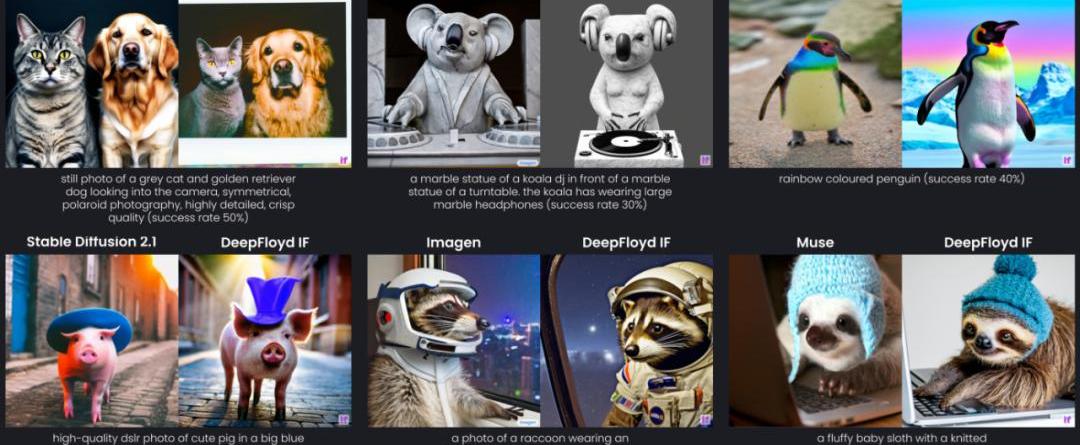

根據官方演示的效果,Imagen不僅在質量上完勝OpenAI最強的DALL-E2,更重要的是——它能夠正確地生成文本。

迄今為止,沒有任何一個開源模型能夠穩定地實現這一功能。

與其他生成式AI模型一樣,Imagen也依賴于一個凍結的文本編碼器:先將文本提示轉換為嵌入,然后由擴散模型解碼成圖像。但不同的是,Imagen并沒有使用多模態訓練的CLIP,而是使用了大型T5-XXL語言模型。

這次,StabilityAI推出的DeepFloydIF復刻的正是這一架構。

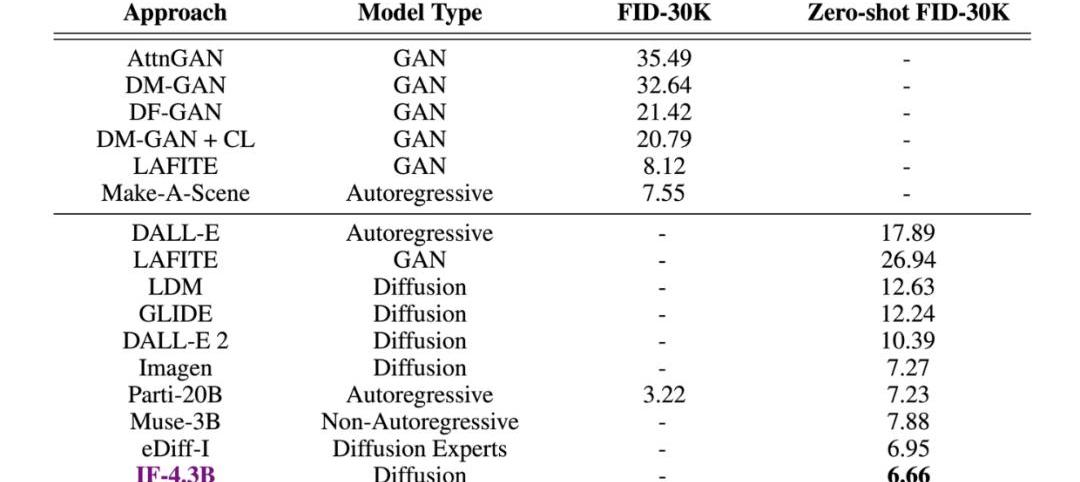

甚至在測試中,DeepFloydIF憑借著COCO數據集上6.66的zero-shotFID分數,直接超越了谷歌的Imagen,以及一眾競品。

下一代圖像生成AI模型

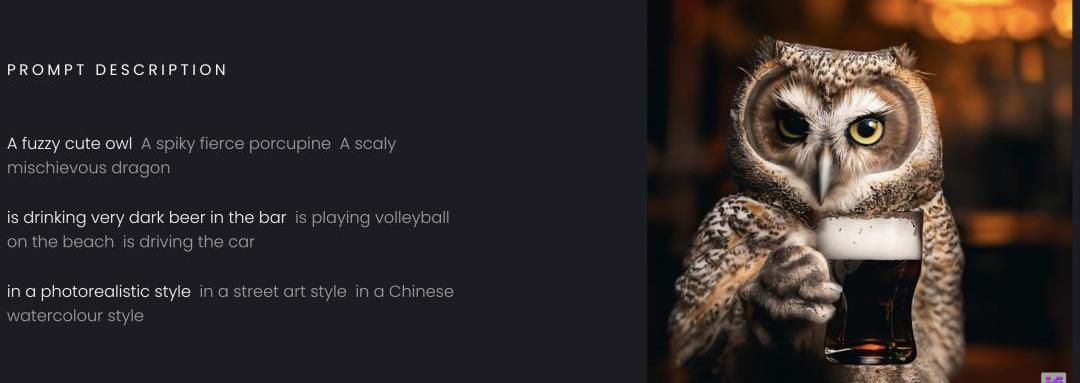

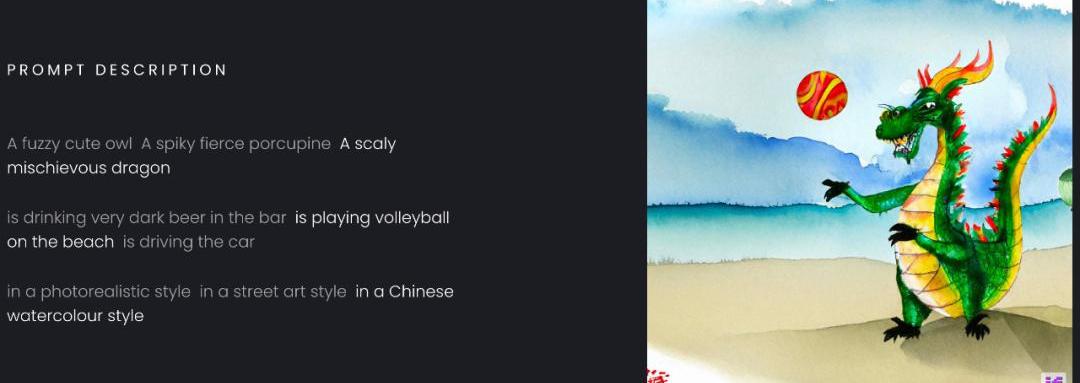

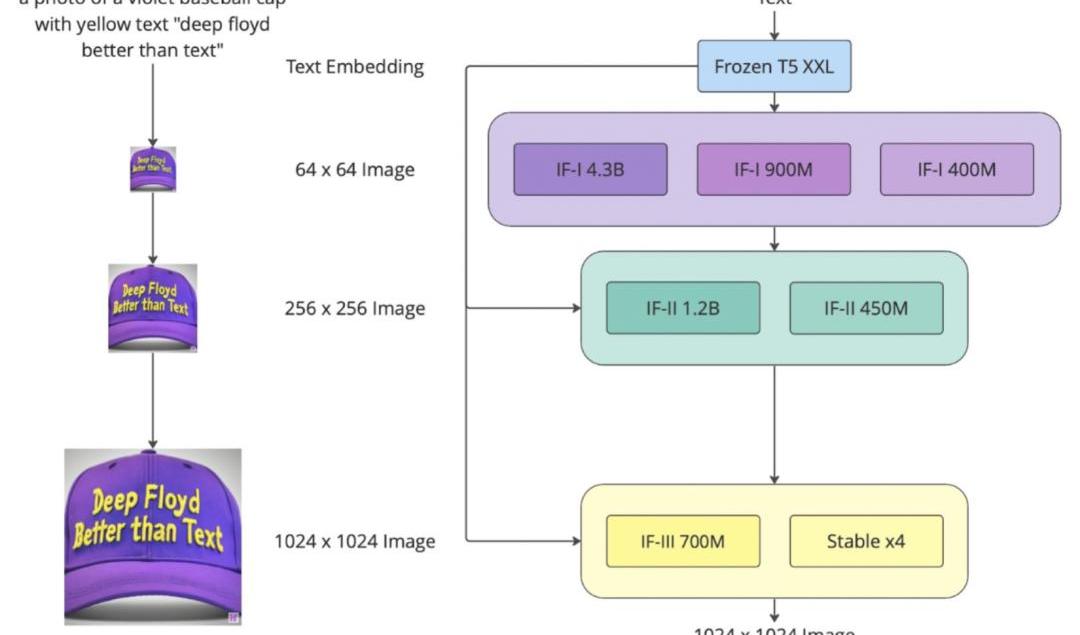

具體來說,DeepFloydIF是一個模塊化、級聯的像素擴散模型。

模塊化:

DeepFloydIF由幾個神經模塊組成,它們在一個架構中相互協同工作。

級聯:

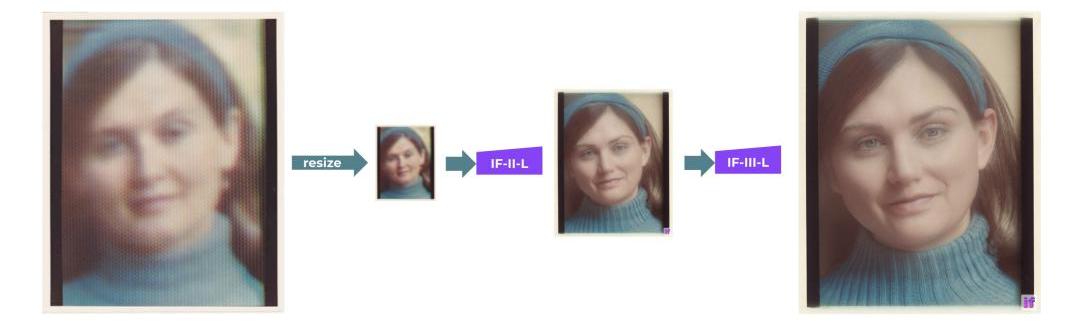

DeepFloydIF以多個模型級聯的方式實現高分辨率輸出:首先生成一個低分辨率的樣本,然后通過連續的超分辨率模型進行上采樣,最終得到高分辨率圖像。

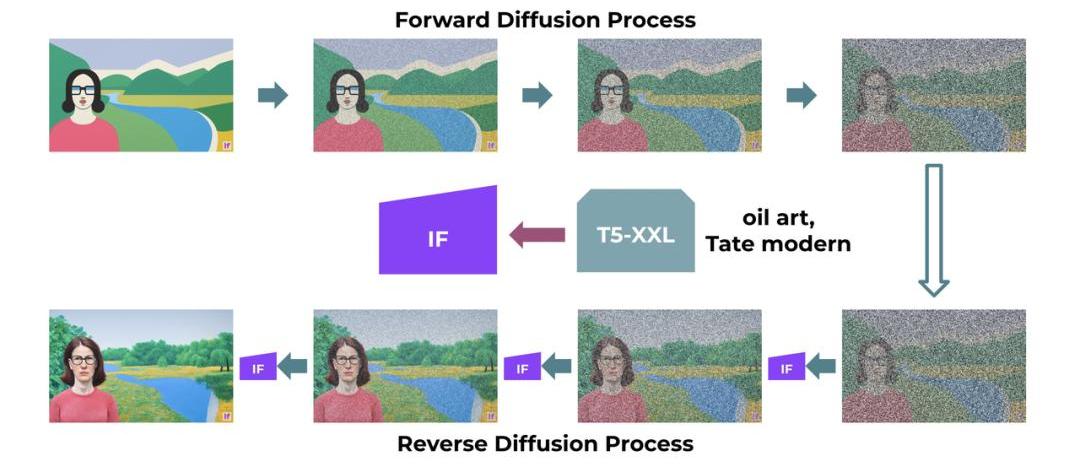

擴散:

DeepFloydIF的基本模型和超分辨率模型都是擴散模型,其中使用馬爾可夫鏈的步驟將隨機噪聲注入到數據中,然后反轉該過程從噪聲中生成新的數據樣本。

像素:

DeepFloydIF在像素空間工作。與潛在擴散模型不同,擴散是在像素級別實現的,其中使用潛在表征。

上面這個流程圖展示的就是,DeepFloydIF三個階段的性能:

階段1:

基本擴散模型將定性文本轉換為64x64圖像。DeepFloyd團隊已經訓練了三個版本的基本模型,每個版本都有不同的參數:IF-I400M、IF-I900M和IF-I4.3B。

階段2:

為了「放大」圖像,團隊將兩個文本條件超分辨率模型應用于基本模型的輸出。其中之一將64x64圖像放大到256x256圖像。同樣,這個模型也有幾個版本:IF-II400M和IF-II1.2B。

階段3:

應用第二個超分辨率擴散模型,生成生動的1024x1024圖像。最后的第三階段模型IF-III擁有700M參數。

值得注意的是,團隊還沒有正式發布第三階段的模型,但DeepFloydIF的模塊化特性讓我們可以使用其他上采樣模型——如StableDiffusionx4Upscaler。

團隊表示,這項工作展示了更大的UNet架構在級聯擴散模型的第一階段的潛力,從而為文本到圖像合成展示了充滿希望的未來。

數據集訓練

DeepFloydIF是在一個定制的高質量LAION-A數據集上進行訓練的,該數據集包含10億對。

LAION-A是LAION-5B數據集英文部分的一個子集,基于相似度哈希去重后獲得,對原始數據集進行了額外的清理和修改。DeepFloyd的定制過濾器用于刪除水印、NSFW和其他不適當的內容。

目前,DeepFloydIF模型的許可僅限于非商業目的的研究,在完成反饋的收集之后,DeepFloyd和StabilityAI團隊將發布一個完全免費的商業版本。

參考資料:

https://stability.ai/blog/stablevicuna-open-source-rlhf-chatbot

https://stability.ai/blog/deepfloyd-if-text-to-image-model

來源:江南時報網 作者:南京產業協會 元宇宙正逐步從概念變為現實,各類帶有元宇宙標簽的文旅實踐案例頻繁涌現.

1900/1/1 0:00:00將于美國西部時間2023年5月6日晚上8點舉行。本次AMA活動將邀請AI領域的資深專家,深度剖析AGI技術的前世今生,探討人工智能對我們的生活和未來的影響.

1900/1/1 0:00:00原文:《「代幣化的未來」的?STO?的機遇,是在淘金熱中賣鏟子》 原文作者:北辰 原文來源:鏈茶館 在香港Web3嘉年華的閉幕式中.

1900/1/1 0:00:001.金色觀察|不到一個月37.5萬倍如何抓住下一個PEPEPEPE在短短21天內上漲375,000倍之后,改變了許多人的生活。你也可以通過Meme幣改變你的生活.

1900/1/1 0:00:00撰文:SuiNetwork本文將為開發人員在SuiNetwork上的最佳實踐做快速參考。Sui是基于第一原理重新設計和構建而成的L1公有鏈,旨在為創作者和開發者提供能夠承載Web3中下一個十億用.

1900/1/1 0:00:00文/孟永輝 當元宇宙的熱度尚未退卻,以ChatGPT為代表的新熱點又開始出現,一時間熱鬧異常,人頭攢動。曾經,因為互聯網的退潮而冷淡下來的科技領域,再一次掀起了新的高潮.

1900/1/1 0:00:00