BTC/HKD+5.98%

BTC/HKD+5.98% ETH/HKD+8.32%

ETH/HKD+8.32% LTC/HKD+4%

LTC/HKD+4% ADA/HKD+9.2%

ADA/HKD+9.2% SOL/HKD+9.15%

SOL/HKD+9.15% XRP/HKD+8.85%

XRP/HKD+8.85%

作者|劉大一恒、齊煒禎、晏宇、宮葉云、段楠、周明

編者按:微軟亞洲研究院提出新的預訓練模型ProphetNet,提出了一種新的自監督學習目標——同時預測多個未來字符,在序列到序列的多個自然語言生成任務都取得了優異性能。

大規模預訓練語言模型在自然語言理解和自然語言生成中都取得了突破性成果。這些模型通常使用特殊的自監督學習目標先在大規模無標記語料中進行預訓練,然后在下游任務上微調。

傳統自回歸語言模型通過估計文本語料概率分布被廣泛用于文本建模,序列到序列的建模,以及預訓練語言模型中。這類模型通常使用teacher-forcing的方法訓練,即每一時刻通過給定之前時刻的所有字符以預測下一個時刻的字符。然而,這種方式可能會讓模型偏向于依賴最近的字符,而非通過捕捉長依賴的信息去預測下一個字符。有如以下原因:局部的關系,如兩元字符的組合,往往比長依賴更強烈;Teacher-forcing每一時刻只考慮對下一個字符的預測,并未顯式地讓模型學習對其他未來字符的建模和規劃。最終可能導致模型對局部字符組合的學習過擬合,而對全局的一致性和長依賴欠擬合。尤其是當模型通過貪心解碼的方式生成序列時,序列往往傾向于維持局部的一致性而忽略有意義的全局結構。

萬向區塊鏈:從未在Twitter等社交軟件上開設聲稱提供加密貨幣分析等服務的官方社群:5月24日消息,萬向區塊鏈(Wanxiang Blockchain)官方發推提醒稱,萬向區塊鏈及公司高管從未在Telegram、Twitter、Whatsapp、微信等社交軟件上開設聲稱提供加密貨幣分析、交易咨詢、培訓等服務的官方社群。請勿輕信以萬向區塊鏈或公司高管名義發出的相關社群邀請及消息,注意進行信息甄別。[2023/5/24 22:14:58]

ProphetNet

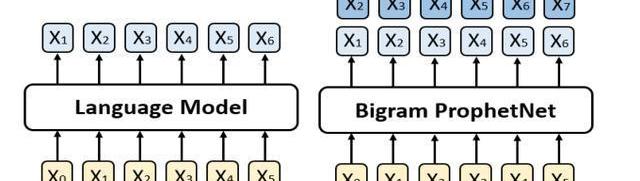

針對上述問題,我們提出了一個新的seq2seq預訓練模型,我們稱之為ProphetNet。該模型帶有一個新穎的自監督學習目標函數,即預測未來的N元組。與傳統seq2seq的Teacher-forcing每一時刻只預測下一個字符不同,ProphetNet每一時刻將學習去同時預測未來的N個字符。如圖1所示:

圖1:左邊是傳統的語言模型,每一時刻預測下一時刻的字符。右邊是Bigram形式下的ProphetNet,每一時刻同時預測未來的兩個字符。

美國地方法院駁回Yuga Labs創作者的反對動議:金色財經報道,根據周五的一份文件,NFT開發商Yuga Labs和一位藝術家及其NFT商業伙伴之間正在進行的法律糾紛仍在繼續,因為美國聯邦法院駁回了Bored Ape Yacht Club創作者的反對動議。

Yuga Labs于6月首次對加州藝術家Ryder Ripps和NFT市場Not Larva Labs的創始人Jeremy Cahen提起訴訟,指控他們抄襲和銷售NFT系列,貶低原始Bored Ape產品。

被告Ripps和Cahen在10月提出了駁回Yuga Labs的反對意見的動議,同時提出了反公眾參與戰略訴訟(SLAPP)動議。目前,中加州地區法院已經駁回了這些動議。[2022/12/18 21:51:13]

預測未來N元組這一自監督學習目標在訓練過程中顯式地鼓勵模型在預測下一個字符時考慮未來更遠的字符,做到對未來字符的規劃,以防止模型對強局部相關過擬合。

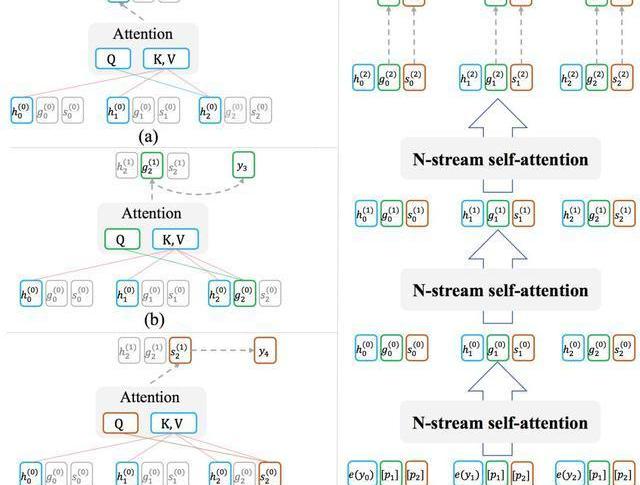

ProphetNet基于Transformer的seq2seq架構,其設計有兩個目標:1.模型能夠以高效的方式在訓練過程中完成每時刻同時預測未來的N個字符;2.模型可以靈活地轉換為傳統的seq2seq架構,以在推理或微調階段兼容現有的方法和任務。為此,我們受XLNet中Two-streamselfattention的啟發,提出了用于模型decoder端的N-streamself-attention機制。圖2展示了bigram形式下的N-streamself-attention樣例。

Amber Group宣布完成3億美元C輪融資:12月16日消息,Amber Group官方推特發文宣布已完成3億美元C輪融資,Fenbushi CapitalUS領投,其他加密原生投資者和家族辦公室跟投。Amber Group表示,在FTX崩潰之前,Amber以30億美元估值進行B+輪融資,為可能延長的加密冬天做準備,FTX崩潰后繼續進行C輪融資。

在投資者的支持下,其2023年的首要任務是專注于核心業務和客戶。此前12月9日,據金融時報報道,Amber Group表示該公司已從一個新的主權基金籌集約5000萬美元資金,交易將于明年1月宣布。新資本對該公司的估值為30億美元,與2月份持平。[2022/12/16 21:48:40]

除了原始的multi-headself-attention之外,N-streamself-attention包含了額外的N個predictingstreamself-attention,用于分別預測第n個未來時刻的字符所示。每一個predictingstream與mainstream共享參數,我們可以隨時關閉predictingstream以讓模型轉換回傳統seq2seq的模式。

薩爾瓦多持有的比特幣可能出現未實現的賬面損失:金色財經報道,薩爾瓦多自去年制定加密貨幣法定貨幣以來,該國一直沒有正式宣布其持有的任何資產,現在很可能出現未實現的賬面損失。隨著薩爾瓦多面臨1 月份到期的8 億美元債務,有關薩爾瓦多比特幣財務的問題隨之而來。與此同時,該國立法者正在考慮旨在監管數字資產提供商和發行人的立法,這將有助于實現其期待已久的計劃,即使用區塊鏈技術發行10億美元的比特幣支持債券。

根據 Nayib Bukele 的社交媒體帖子,薩爾瓦多已經購買了 2,381 個比特幣,還不包括他本月早些時候宣布的每天一個比特幣。除此之外,沒有關于薩爾瓦多迄今為止花費了多少的官方或公開記錄。[2022/11/26 20:47:12]

圖2:(a)為mainstreamself-attention;(b)為1-stpredictingstreamself-attention;(c)為2-ndpredictingstreamself-attention;(d)展示了n-streamself-attention的輸入輸出及流程。

華納兄弟將推出《權力的游戲》系列NFT:11月3日消息,華納兄弟宣布將于今年冬天推出HBO劇集《權力的游戲》系列NFT,并與Nifty的平臺合作。據悉,NFT系列可能會在2023年之前上市,并將被稱為“權力的游戲:建立你的王國”。

NFT將允許持有者創建領域頭像(與該系列相關)并可以訪問系列中的額外物品以完成他們的頭像。NFT持有者有資格為他們的頭像獲得虛擬武器,積累隊友,并優化他們的位置和角色,這將允許持有者建立自己的王國。

目前,華納兄弟尚未透露有關該系列定價的詳細信息。[2022/11/3 12:12:45]

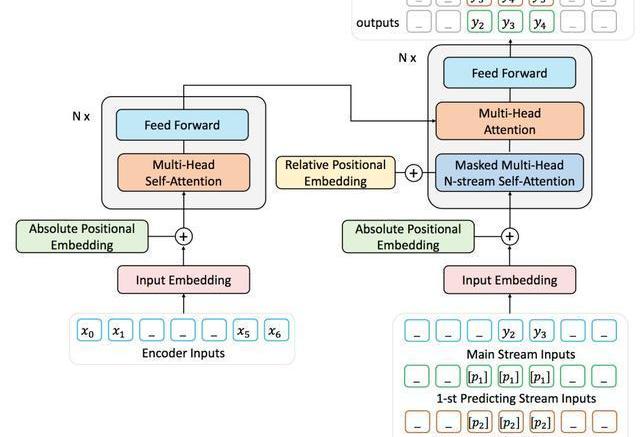

由于難以獲取到大量帶標記的序列對數據,我們用去噪的自編碼任務通過大量無標記文本預訓練ProphetNet。去噪的自編碼任務旨在輸入被噪音函數破壞后的序列,讓模型學習去復原原始序列。該任務被廣泛應于seq2seq模型的預訓練中,如MASS、BART、T5等。本文中使用MASS的預訓練方式,通過引入提出的predictingn-stream自監督學習目標函數預訓練ProphetNet。我們以bigram形式的ProphetNet為例,整個流程如圖3所示:

圖3:二元形式下的Prophet整體框架圖

實驗結果

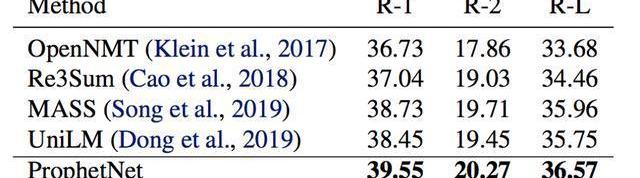

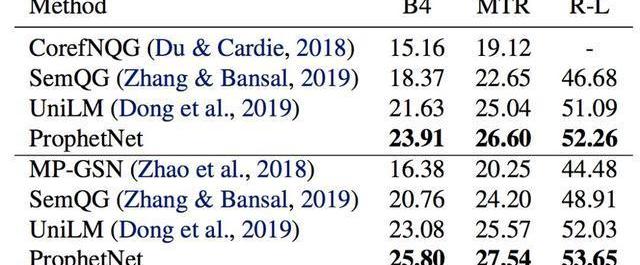

我們使用兩個規模的語料數據訓練ProphetNet。ProphetNet包含12層的encoder和12層的decoder,隱層大小為1024。先在BERT所使用的BookCorpus+Wikipedia的數據上預訓練模型,將模型在Textsummarization和Questiongeneration兩個NLG任務上的三個數據集微調并評估模型性能。與使用同等規模數據的預訓練模型相比,ProphetNet在CNN/DailyMail、Gigaword和SQuAD1.1questiongeneration數據集上都取得了最高的性能,如表1-3所示。

表1:CNN/DailyMail測試集結果

表2:Gigaword測試集結果

表3:SQuAD1.1測試集結果SQuAD1.1交換驗證測試集結果

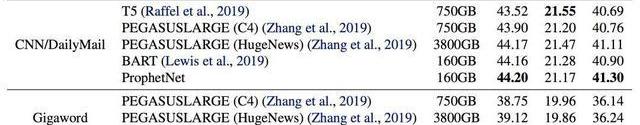

除了使用16GB的語料訓練模型,我們也進行了更大規模的預訓練實驗。該實驗中,我們使用了160GB的語料預訓練ProphetNet。我們展示了預訓練14個epoch后的ProphetNet在CNN/DailyMail和Gigaword兩個任務上微調和測試的結果。如表4所示。需要注意的是,在相同大小的訓練數據下,我們模型的預訓練epoch僅約為BART的三分之一。我們模型的訓練數據使用量僅約為T5和PEGASUSLARGE的五分之一,約為PEGASUSLARGE的二十分之一。盡管如此,我們的模型仍然在CNN/DailyMail上取得了最高的ROUGE-1和ROUGE-LF1scores。并在Gigaword上實現了新的state-of-the-art性能。

表4:模型經大規模語料預訓練后在CNN/DailyMail和Gigaword測試集的結果

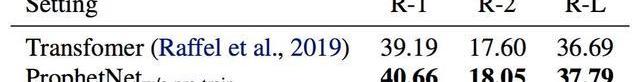

為了進一步探索ProphetNet的性能,我們在不預訓練的情況下比較了ProphetNet和Transformer在CNN/DailyMail上的性能。實驗結果如表5所示,ProphetNet在該任務上超越了同等參數量的Transformer。

表5:模型不經過預訓練在CNN/DailyMail驗證集結果

總結

本文介紹了微軟亞洲研究院在序列到序列模型預訓練的一個工作:ProphetNet,該模型提出了一種新的自監督學習目標,在同一時刻同時預測多個未來字符。并通過提出的N-streamself-attention機制高效地實現了模型在該目標下的訓練。實驗表明,該模型在序列到序列的多個自然語言生成任務都取得了不錯的性能。我們將在之后嘗試使用更大規模的模型架構和語料進行預訓練,并進一步深入地探索該機制。

論文鏈接:https://arxiv.org/pdf/2001.04063.pdf

原力計劃

《原力計劃-學習力挑戰》正式開始!即日起至3月21日,千萬流量支持原創作者!更有專屬等你來挑戰

Python數據清理終極指南口罩檢測識別率驚人,這個Python項目開源了談論新型冠狀病、比特幣、蘋果公司……沃倫巴菲特受訪中的18個金句,值得一看!天貓超市回應大數據殺熟;華為MateXs被熱炒至6萬元;Elasticsearch7.6.1發布一張圖對比阿里、騰訊復工的區別不看就虧系列!這里有完整的Hadoop集群搭建教程,和最易懂的Hadoop概念!|附代碼

關注商道創投網,創投路上不迷茫↑↑↑ 韓彥是光速中國的創始合伙人,從事早期A輪融資十余年來,他的投資成績單上已經涵蓋了小鵬汽車、樊登讀書會、途家、滿幫集團等多個明星項目.

1900/1/1 0:00:00現在隨著支付寶、微信支付的普及,我們生活中使用錢幣的機會越來越少。而中國人民銀行更是早在2014年已經開始了對數字貨幣的研究,以后貨幣恐怕就要完全數字化、虛擬化了.

1900/1/1 0:00:00來源:防騙大數據 近期,韓國媒體曝光,有人在網絡上建立私密付費聊天組,分享女性不雅照,涉及強奸、嚴重侮辱女性等,受害者包括未成年人。這一事件被稱為“N號房”事件,引發軒然大波.

1900/1/1 0:00:00如需報告請登錄。 1、ECMO直接參與救治NCP重癥患者,但設備緊缺ECMO是重癥治療方面的一種技術,對于受新冠病感染的重癥患者,利用ECMO設備可以暫時代替人的心和肺起作用,等待心肺功能恢復.

1900/1/1 0:00:00被“吵翻天”的老羅抖音直播首秀終于揭開了神秘面紗,就像等待福爾摩斯懸案中的結局,無論是否是老羅的粉絲,喜歡他或不喜歡,聽過他或沒聽過他,都被“羅永浩熱”給卷進了羅永浩的抖音直播間.

1900/1/1 0:00:00法版《SKAM》第5季正在熱更中...從開播到現在收視屢屢創新高!雖然有那么多國家版本的SKAM.

1900/1/1 0:00:00